“(计算机)从2D到3D世界,是1995年之后最大的消费电子技术转折点,这将彻底改变人们的计算体验。”RPeesmc

从人们的角度来看,这个世界永远在变化。当我们四处移动时,我们的目光也游走在整个环境中,丰富动态的场景信息不停地被传送到我们的大脑里。我们可以理解这些不断改变的信号,并以此生成对这个世界的根本性了解,从而和这个世界进行无缝交互。在过去三十年的计算机视觉领域中,有相当庞大的工作被投入到了这一块,尝试通过颜色和深度摄像头来模拟人类的感知能力。可以说,计算机视觉一直是人工智能领域里最活跃的部分,指纹识别、掌纹识别、人脸识别都属于其应用,而深度摄像头就是计算机的眼睛。RPeesmc

深度摄像头技术解析

那么究竟什么是深度摄像头?消费者最熟悉的当属微软开发的Kinect系列,Leap Motion的体感设备,三星智能电视的手势遥控功能等产品,这些均是深度摄像头的RPeesmc

传统体感类应用。实现深度探测的主流技术目前有三类:

1:(单目)结构光技术路线

代表公司:PrimeSense / 代表产品:Kinect I代

主要优势:识别距离远 / 主要问题:硬件难度和成本稍高

阵营公司:Apple(PrimeSense)、Microsoft、Intel、Google, etc.

主流评价:目前最主流的机器视觉工程化实现方法RPeesmc

2:双目可见光(可配合红外补光)

代表公司:LeapMotion / 代表产品:LeapMotion

主要优势:高精度 / 主要问题:检测范围太小(不足1米),远距离检测问题很多

阵营公司:LeapMotion

主流评价:应用场景太少RPeesmc

3:飞行时间法(ToF)

代表公司:Microsoft / 代表产品:Kinect II代

主要优势:体感应用好 / 主要问题:传感器供应受限、体积和功耗大、像素低

阵营公司:Microsoft、SoftKinetic(刚被SONY收购)

主流评价:除微软在体感游戏之外民用应用不多RPeesmc

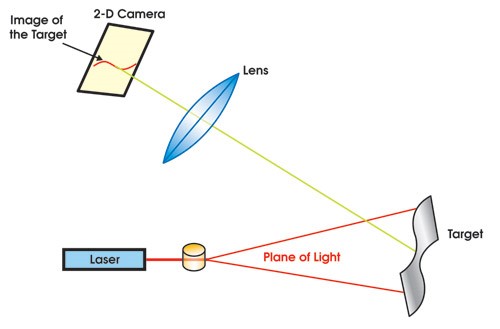

以结构光技术为例,其原理如图。

光源向检测空间内投射经过编码的激光光斑阵列,对空间进行标定并辅助计算三维空间位置。它是整合了衍射光学、图像处理、计算视觉算法和处理器计算平台的跨界组合工程,非标准的光学器件需要设计定制。其关键技术包括两个部分:投射光学系统、“结构光”pattern编码和衍射光学系统设计;以及图像处理和视觉计算算法。RPeesmc

该技术的代表公司是PrimeSense,它创立于 2005 年,于 2006 年研发出 3D 传感器,在当年的 E3 大展上与微软建立了联系,并催化出代号为 Project Natal 的神秘项目。等到 2009 年 E3 大展时,微软发布了内置 PrimeSense 3D 传感器的 Kinect,成功掀起了“体感游戏”大潮。PrimeSense的原理,是使用3D光学感测技术,使用红外线系统来绘制场景的网格。通过传感器读取网格中的点,并结合来自CMOS传感器的图像信息,绘制出包含了深度信息的3D地图。这种方法被称为“RGB-D”,它由传统的红色,绿色和蓝色的图像信息加上“深度”信息构成。其核心为Light Coding技术,是利用连续光(近红外线)对测量空间进行编码,经感应器读取编码的光线,交由芯片运算进行解码后,产生成一张具有深度的图像。Light Coding技术的关键是激光散斑,当激光照射到粗糙物体、或是穿透毛玻璃后,会形成随机的反射斑点,称之为散斑。散斑具有高度随机性,也会随着距离而变换图案,空间中任何两处的散斑都会是不同的图案,等于是将整个空间加上了标记,所以任何物体进入该空间、以及移动时,都可确切纪录物体的位置。RPeesmc

深度摄像头供应格局

随着深度摄像头技术的不断发展,更多机器视觉应用正在不断涌现,例如行为捕捉和分析用于智能安防,环境感知(SLAM)用于视觉导航,消费类 3D建模等,同时深度摄像头也是近年来最火爆的AR/VR设备的核心模块之一。高级行为分析功能必需基于三维深度信息实现,此前市场上只有基于PrimeSense方案的体感游戏摄像头可用,在2013年PrimeSense被Apple 收购,其对外供货和技术授权在15年中止,业界急需要合适的替代产品。例如有一款采用PrimeSense开发板设计的iPad外置深度摄像头产品,在Kickstarter上募集了约130万美金,同样因为Apple收购PrimeSense的原因,类似项目全部陷入困境。在AR/VR设备应用中,远距离深度摄像头用于环境感知和建模;近距离深度摄像头用于手势识别。预计将来 99% 的 AR 设备和 50% 以上的 VR 设备将配备深度摄像头,而这两类应用的崛起,也将大力推动深度摄像头市场的增长。RPeesmc

PrimeSense的产品有深度摄像头模块,有完善的SDK(其中最著名的是开源的Open NI应用程序接口),更有其定制的DSP+硬件加速器芯片以及强大的专利池。在PrimeSense被Apple 收购之后,市场上类似方案供应几乎成为空白,随后谷歌、英特尔、脸书旗下Oculus、索尼和三星等企业都相继在这一领域进行了投入,收购动作频繁。谷歌Project Tango,利用深度摄像头进行机器人室内导航;英特尔演示RealSense深度摄像头对无人机进行视觉导航等等……。可以说,深度摄像头是所有需要视觉传感器的机器,包括机器人、无人机、工业设备的必需模块。据IHS预计,到2019年手势感应传感器全球市场规模将从2015年的23亿达到95亿美金,年复合增长率达到42.6%。RPeesmc

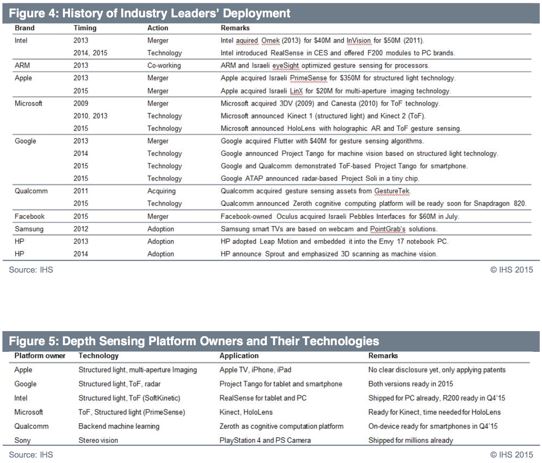

下图是该产业领导厂商主要技术发展及深度摄像头平台情况。

上图显示了科技行业巨头在深度摄像头领域的布局,他们通过收购构筑了各自的技术护城河。其中,微软Kinect一代的技术方案供应商,机器视觉民用化的先驱PrimeSense被苹果收购可以视为一个转折点,收购以后,其对外授权和供货会在 2015 年终止,所以那些使用了PrimeSense技术的厂商们不得不寻找替代方案,再加上AR/VR设备的兴起,让国内一些初创企业盯住了这一市场,图漾科技即是其中之一。RPeesmc

图漾:业界最独特的技术路线

费浙平曾经是处理器巨头ARM在中国大陆的第一位员工,在全球顶尖的CPU和GPU公司工作十多年,于2013年开始启动深度摄像头的技术研发,团队的技术合伙人来自于国内机器视觉领域的著名团队Click研发小组,在光学、硬件和算法上非常有经验和积累。在强大的技术团队背景下,图漾立志成为机器视觉领域的世界级核心技术平台。RPeesmc

2015年初,图漾科技获得Pre-angel 400万天使轮融资,目前已经完成了所有核心技术的研发和器件定制,产品已经开始在诸多行业客户中使用。区别于主流的单目结构光技术方案,他们创造性地采用了主动双目的技术路线,主动双目(Active Stereo)技术的不断演进和优化,能够把深度摄像头性能推向极致,同时彻底规避了与市场先行者的专利风险。主动双目方案可以看成是纯双目方案和单目结构光两种方案的融合,由于这两种方式都可以获得深度信息,在系统鲁棒性方面会大大超过现有方案。在某些环境下(比如室外)由于环境光的干扰,该方案可以直接转变成纯双目方案,继续获得深度信息而不会直接失效,也可以真正杜绝不同深度摄像头之间空间散斑的互相干扰(这个问题在机器视觉社区非常常见,但单目结构光方案由于原理问题,无法避免)。同时双目结构光方案的光学标定方式不同于单目结构光,激光发射器(产品寿命最大瓶颈)可以直接替换,由此带来摄像头模块的工作时间可以达到商用和工业领域的高可靠性和高可用性需求,还能带来维护成本的大幅度降低(不需要整个模块替换),这对行业用户的重要性不言而喻。RPeesmc

费浙平表示,图漾目前已完成1500万人民币的pre-A轮融资,本轮融资由专投机器人领域的两个投资机构参投,资金将主要用于产品商业化布局和硬件设备落地,普及更多的客户。“深度摄像头能够获取世界的三维信息,由此给VR/AR、动作捕捉、三维扫描与打印、室内导航与定位等应用提供了基础的技术支持。有了深度摄像头,你的设备将读懂这个世界所发生的一切,更加智能。”他表示。RPeesmc

根据他的规划,图漾的第一个产品型态是深度摄像头(传感器),可利用视觉计算原理,计算出拍摄场景内物体的3维空间位置信息,在此基础上可以实现环境感知、体感、建模、行为识别等各种应用。在第二阶段,跟行业合作伙伴配合,为最终客户提供基于深度信息的视觉应用开发支持,比如3D建模和SLAM等,构建起深度技术应用的技术平台。图漾的硬件技术发展路线和方向有两个,一是提供适合移动设备用的小型化低功耗深度摄像头,二是远距离和超高分辨率的高性能产品。RPeesmc

在竞争格局上,费浙平表示,被Apple收购后的PrimeSense基本上会是自用,微软绑定了Win10,也在明显趋于封闭,而且它不会进入硬件模块市场;英特尔的产品规格非常固定,且需绑定 x86 处理器,应用场景比较受限;谷歌志不在成为硬件供应商,甚至有朝一日很可能会彻底开源其Project Tango的源代码,帮助促进深度摄像头的大规模普及应用。以色列有一个技术极好的创业公司群体,但是这类企业的目标在于被巨头收购,难以成为可靠的合作伙伴。事实上,在过去的12个月里面,市面上大多数的深度技术公司都已经被大公司收入旗下了。“这一领域的特点是技术门槛极高,技术发展整体上尚属于早期,整个行业都在技术起飞过程当中。类似于高仿Kinect硬件加软件破解的方式不是我们的兴趣所在,我们的目标是成为世界顶尖的深度技术公司,在这个技术点上做出创造性的领先技术和产品,RPeesmc

支持计算视觉应用从行业扩展到我们每个人的工作和生活当中。”在技术和产品山寨横行的中国市场,有这样愿意挑战业界技术巅峰的企业实属罕见。RPeesmc

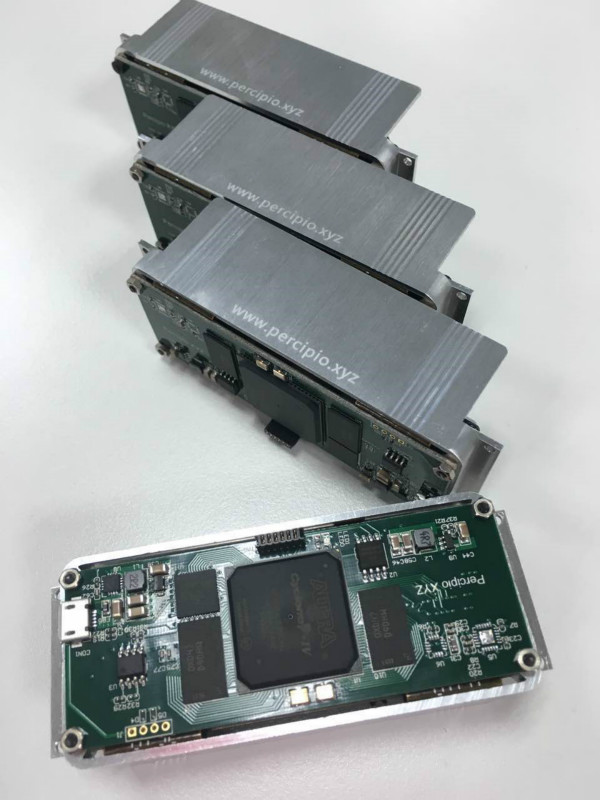

费浙平解释深度摄像头的几个关键技术规格,一个是检测范围,看最大检测距离;第二是检测精度,看误差多少;第三是检测角度,看镜头的视角多大;第四是检测速度,每秒能刷新多少次。他表示目前已有小批量试用模组提供给早期客户评估,该深度摄像头采用双目立体视觉,配以红外结构光辅助投影,能够获得比传统RPeesmc

立体视觉更多的景深细节。板载深度数据专用处理器,所有图像处理均在设备端高速完成,直接输出深度数据供客户调用处理。这一型号采用裸板模组设计,适合企业客户直接用于自家产品的安装使用,适用于机器人导航避障,及低精度的姿态识别等领域应用,支持Linux、windows操作系统。

首款产品模组规格描述:RPeesmc

- 尺寸88mmx38mmx35mm,基线长度55mm。

- 输出深度分辨率560x460@10fps,micro USB 2.0。

- 设备功耗为3.5w。

- 检测距离1-5m,水平检测范围58°。

- 供电方式:双USB供电。

- 提供模组安装定位孔。

“目前我们的深度摄像头模组内置专用图像处理芯片,能够高速实时检测物体的三维信息,无需占用任何设备外计算资源。通过巧妙的光学设计,保证深度传感器的识别范围有了更大的延伸,实现最远可达到10米内的目标检测,并实现双图像捕获激光投射,能够对物体三维信息实时测量,检测精度达到毫米级,” 费浙平指出,“而且即插即用,无需复杂的驱动,可直接输出深度信息流,支持不同的平台。此外我们对所有开发者免费开放丰富的开发包,可以让开发者充分发挥想象,将深度信息的利用发挥到极致。同时也为企业客户提供交钥匙方案,摄像头模组可以轻松外置或嵌入各型号电子产品,帮助客户提升产品的国际竞争力。” 值得注意的是,目前的模组导出的数据是原始数据,需要客户自己去进一步分析处理,因此图漾现阶段选择的都是具备一定技术实力的客户。RPeesmc

视觉处理器:新的蓝海

费浙平指出,目前的处理器架构不足以支撑现有的计算机视觉的发展。未来关于深度识别方面,也需要专门优化过的处理器来处理相关的应用,才能做到又快又好。近期由于视觉处理器创业公司CogniVue被飞思卡尔收购,该领域的创业机会也被业界看好,谷歌project Tango中所使用的视觉处理器供应商Movidius已经成为当红炸子鸡。“深度摄像头技术发展仍处于早期阶段,还有很长的路要走,同时,这也意味着有很多机会等着我们。”处理器行业出身的费浙平在说到视觉处理器话题时,仍旧两眼放光,让人不禁浮想联翩……。RPeesmc